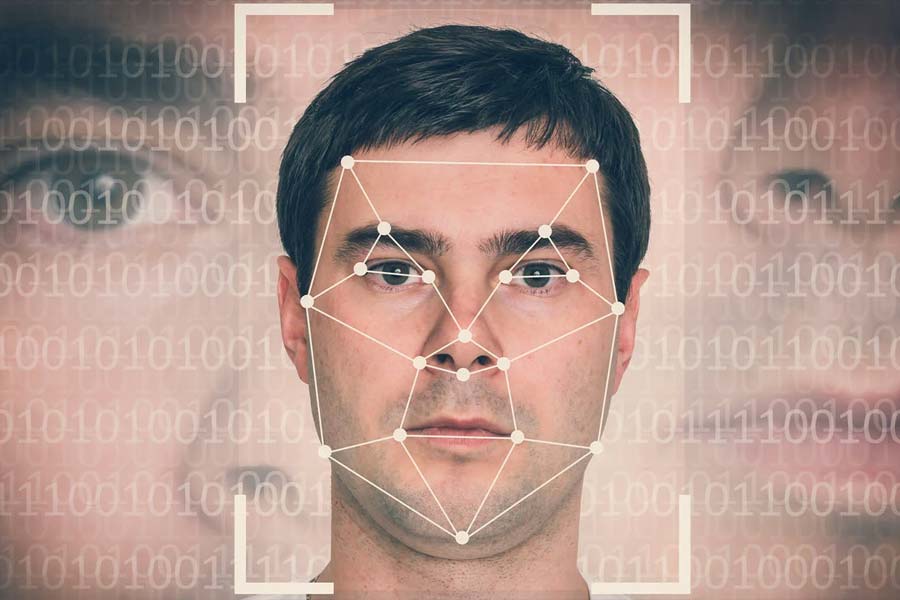

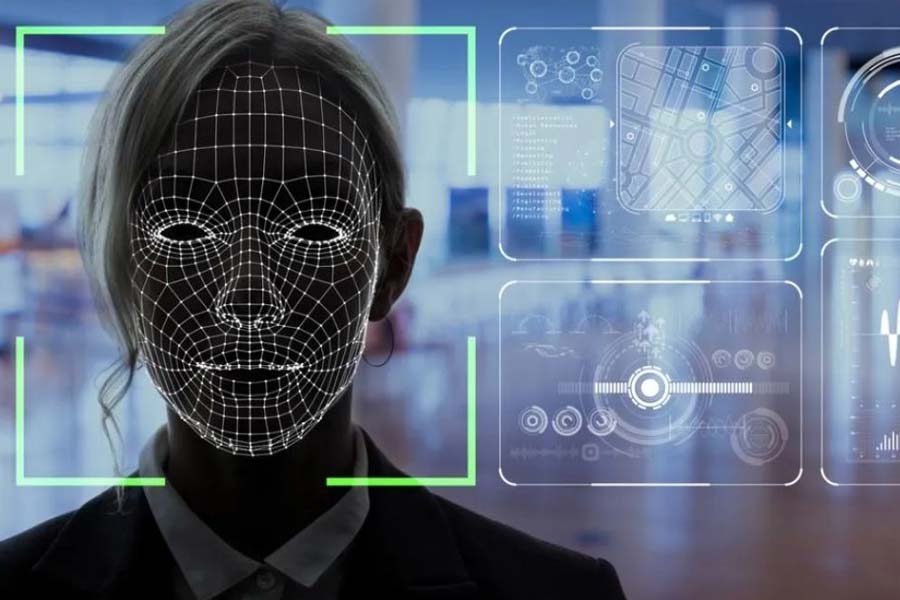

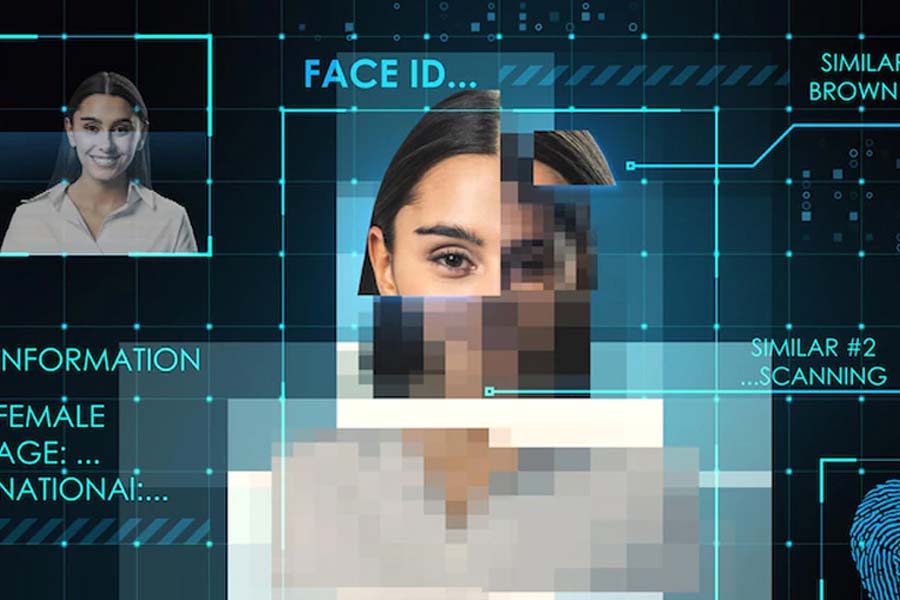

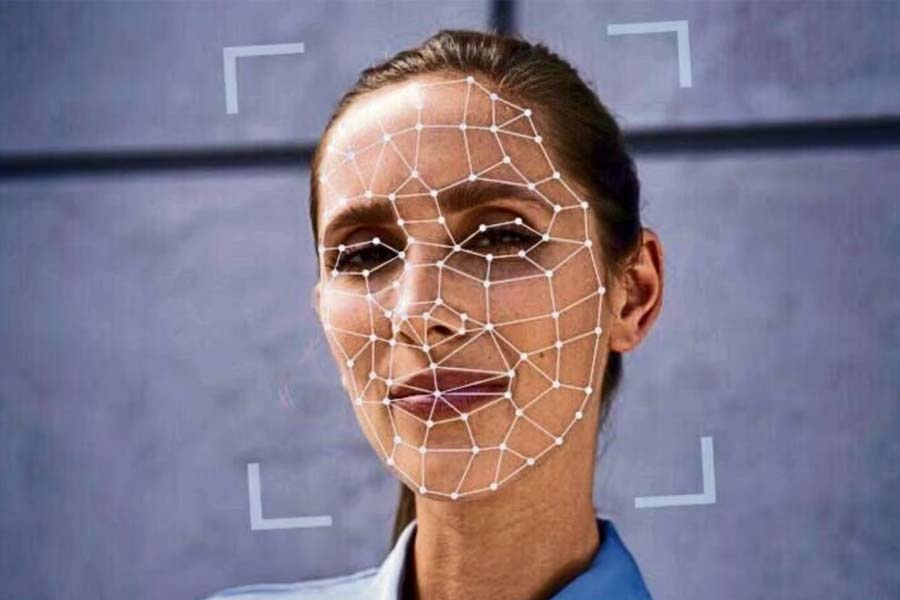

প্রযুক্তির ‘জুজু’ যে আর দূরে কোথাও নেই, একেবারে রোজকার যাপনে এসে পড়েছে, তা-ই বুঝিয়ে দিয়েছে সাম্প্রতিক একের পর এক ‘ডিপফেক’ কাণ্ড! এ এমনই এক প্রযুক্তি-কৌশল, যার দৌলতে বিশ্বের যে কোনও মানুষের ছবি বা ভিডিয়োয় মুখচ্ছবি পাল্টে দেওয়া হচ্ছে। অত্যন্ত সূক্ষ্ম এবং প্রায়-নিখুঁত ভাবে এক জনের শরীরে জুড়ে দেওয়া হচ্ছে অন্যের ধড় এবং মুণ্ড।

এর জন্য শুধুই জানতে হয় ‘ডিপ লার্নিং’ আর কৃত্রিম বুদ্ধিমত্তার (আর্টিফিশিয়াল ইন্টেলিজেন্স, সংক্ষেপে ‘এআই’) প্রযুক্তি। বিশ্বের যে কোনও প্রান্তে বা প্রত্যন্ত অঞ্চলে বসে যে কোনও মানুষই এই কাজ করতে পারেন। আর সেই সব জাল ছবি-ভিডিয়ো সমাজমাধ্যমে ছড়িয়ে ফেলতে পারলেই কার্যসিদ্ধি— জনমানসে বিরূপ প্রতিক্রিয়া, ব্যঙ্গবিদ্রুপ, চরিত্রহনন অবশ্যম্ভাবী।